在生成式AI浪潮席卷各行各业的今天,AI厨房助手正迅速从一个新奇的科技概念,演变为家庭和餐饮场景中的刚需应用。从老板电器在AWE 2026上发布的搭载自研“食神”大模型的AI烹饪眼镜,到欧琳的“生活大模型”AI水槽,再到Weavefox联手GLM打造的多模态厨房智能体,AI厨房助手已然成为大模型技术落地的重要战场,也是当前AI面试中频频出现的高频考点--。

很多开发者对这类应用的认知停留在“调用一下大模型API生成菜谱”的层面——遇到概念混淆、原理说不清、面试答不出的困境。本文将从痛点出发,由浅入深地拆解AI厨房助手的技术体系,涵盖核心概念、概念辨析、代码示例、底层原理与面试要点,帮助你建立起从“会用”到“懂原理”的完整知识链路。

一、痛点切入:为什么需要AI厨房助手?

传统烹饪辅助方案的实现方式,大致分为两类:

1. 菜谱App模式——本地存储固定菜谱库,用户按关键词检索。

传统菜谱查询——死数据+硬匹配 recipes = { "番茄炒蛋": {"ingredients": ["番茄", "鸡蛋"], "steps": ["热油", "炒蛋", "加番茄"]}, "宫保鸡丁": {"ingredients": ["鸡丁", "花生", "干辣椒"], "steps": ["腌制", "爆香", "翻炒"]} } def get_recipe(name): return recipes.get(name, "未找到该菜谱")

2. 普通LLM直接调用模式——将用户问题直接传给大模型,原样返回生成结果。

这两种方式的核心痛点:

菜谱App模式:菜谱库容量有限,无法处理“冰箱里只有土豆、青椒和虾仁”这种个性化食材组合;火候、调味等细节缺乏动态适配能力。

普通LLM模式:纯文本生成缺乏视觉感知,无法识别食材品种(老母鸡vs肉鸡)、判断新鲜度;缺乏私域知识,生成的菜谱千篇一律,做不到“千人千面”。

正是这些痛点的存在,催生了以 “多模态感知 + RAG知识库 + 智能体编排” 为核心架构的新一代AI厨房助手。

二、核心概念讲解:多模态大模型(LMM)

标准定义:多模态大模型(Large Multimodal Model,LMM)是一种能够同时处理和理解多种模态信息(如文本、图像、音频、视频)的人工智能模型,其核心能力是在不同模态之间建立语义对齐与跨模态推理。

生活化类比:传统的大语言模型(LLM)相当于一个“盲人厨师”——他读过海量菜谱,知识渊博,但看不到眼前的食材长什么样。而多模态大模型相当于给这位厨师装上了一双“眼睛”,他不仅能“读菜谱”,还能“看食材”——一眼认出那是老母鸡还是肉鸡、番茄熟没熟,真正做到“所见即所得”。

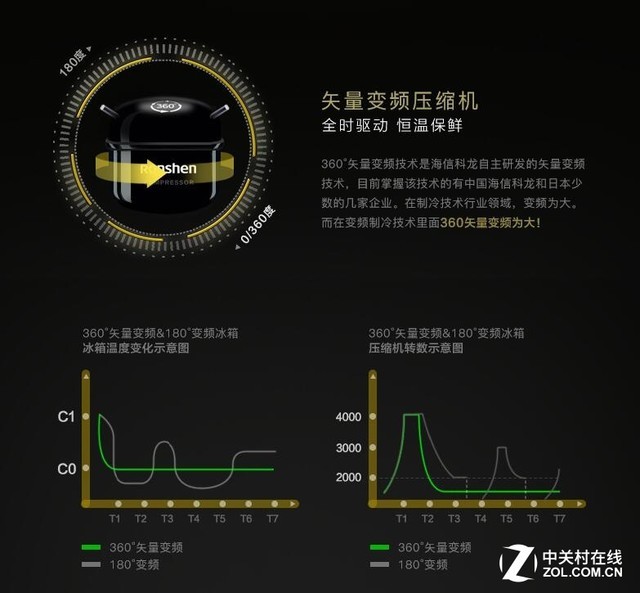

在AI厨房助手中的作用:多模态能力让AI厨房助手能够通过摄像头识别食材种类、判断新鲜度,甚至通过热成像感知锅内的温度分布。例如,老板电器的食神大模型通过3D结构光精准识别食材形态,结合重量传感器判断食材含水量,实现了对“宫保鸡丁”±3℃的火候控制精度,远超人类厨师的±15℃波动-36。

三、关联概念讲解:RAG检索增强生成

标准定义:RAG(Retrieval-Augmented Generation,检索增强生成)是一种将信息检索与大语言模型生成相结合的技术框架,通过在生成过程中先从外部知识库检索相关文档,再将检索结果作为上下文输入LLM,从而增强生成内容的准确性和时效性。

与多模态大模型的关系:多模态大模型负责“感知”(看懂食材、识别状态),RAG负责“调用知识库”(从海量菜谱中检索最适合当前食材的方案)。二者是 “感知”与“调用” 的协同关系。

对比说明:

| 维度 | 纯LLM生成菜谱 | RAG增强生成菜谱 |

|---|---|---|

| 知识来源 | 模型训练参数中的隐含记忆 | 外部知识库实时检索 |

| 准确性 | 容易产生“幻觉”,生成不存在/不可行的菜谱 | 基于真实菜谱数据,可靠性高 |

| 个性化 | 无法利用私域/特定数据 | 可对接私有菜谱库、用户偏好 |

| 更新速度 | 需要重新训练/微调 | 知识库更新即可生效 |

运行机制示意:

用户上传食材图片 → 多模态模型识别 → 提取食材名称/属性 → RAG检索知识库(300万+菜谱) → LLM生成个性化方案四、概念关系与区别总结

清晰梳理三个核心概念的逻辑关系:

大语言模型(LLM) :厨师的大脑——具备通用知识和推理能力,但缺乏视觉感知。

多模态大模型(LMM) :给大脑装上眼睛——在LLM基础上增加了视觉、听觉等感知通道,实现“看得见、听得懂”。

RAG:给大脑接上“图书馆”——在LLM生成之前先从外部知识库检索,确保回答有据可依。

一句话记忆:多模态负责“看”,RAG负责“查”,大模型负责“想”。 三者协同,构成AI厨房助手的核心技术基座。

五、代码示例:搭建一个简易的AI厨房助手

下面基于智谱GLM-4.5V(多模态视觉模型)和GLM-4.6(语言模型),搭建一个“看图识菜、智能出谱”的厨房助手核心模块,这一方案已在实际项目中得到验证-34:

import base64 import requests ========== 配置 ========== API_KEY = "your_zhipu_api_key" BASE_URL = "https://open.bigmodel.cn/api/paas/v4" def encode_image_to_base64(image_path): """将图片转为base64编码""" with open(image_path, "rb") as f: return base64.b64encode(f.read()).decode("utf-8") ========== Step 1: 多模态识别食材 ========== def recognize_ingredients(image_path): """使用GLM-4.5V识别图片中的食材""" b64_img = encode_image_to_base64(image_path) payload = { "model": "glm-4.5v", "messages": [{ "role": "user", "content": [ {"type": "text", "text": "请识别这张图片中的所有食材,用中文列出名称和大致数量。"}, {"type": "image_url", "image_url": {"url": f"data:image/jpeg;base64,{b64_img}"}} ] }] } headers = {"Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json"} resp = requests.post(f"{BASE_URL}/chat/completions", json=payload, headers=headers) return resp.json()["choices"][0]["message"]["content"] 返回食材列表 ========== Step 2: 基于识别结果生成菜谱(此处可接入RAG) ========== def generate_recipe(ingredients_text): """根据识别出的食材生成菜谱""" prompt = f"""你是一位资深厨师。现有食材:{ingredients_text} 请推荐2~3道可行的菜品,并为每道菜提供:名称、烹饪步骤、火候建议。""" payload = { "model": "glm-4.6", "messages": [{"role": "user", "content": prompt}] } headers = {"Authorization": f"Bearer {API_KEY}", "Content-Type": "application/json"} resp = requests.post(f"{BASE_URL}/chat/completions", json=payload, headers=headers) return resp.json()["choices"][0]["message"]["content"] ========== 主流程 ========== def kitchen_assistant(image_path): print("📸 正在识别食材...") ingredients = recognize_ingredients(image_path) print(f"🔍 识别结果:{ingredients}") print("👨🍳 正在生成菜谱方案...") recipe = generate_recipe(ingredients) print(f"📖 推荐菜谱:\n{recipe}") return recipe 运行示例 if __name__ == "__main__": kitchen_assistant("dish.jpg")

关键步骤说明:

GLM-4.5V 负责多模态食材识别,其106B总参数量的MOE架构在图像识别任务中达到同级别开源模型的SOTA水平-34。

GLM-4.6 负责根据识别结果生成结构化菜谱,代码能力对齐Claude Sonnet 4-34。

实践中可进一步接入RAG模块,将识别的食材名称作为检索query,从向量数据库中召回最匹配的菜谱作为LLM生成的上下文-54。

六、底层原理 / 技术支撑点

AI厨房助手背后的关键底层技术主要包括:

1. 多模态对齐技术

核心难点在于让模型理解“文字描述”与“视觉内容”之间的语义对应关系。目前主流的解决方案采用对比学习范式——在亿级图文对数据上进行预训练,使同一语义的文本与图像在向量空间中尽可能接近。

2. RAG的向量检索原理

将海量菜谱库中的每份菜谱通过嵌入模型(Embedding Model)转换为高维向量,存入向量数据库(如Chroma、Pgvector)。用户查询时,将查询文本同样转化为向量,通过相似度计算(如余弦相似度)召回最相关的K个文档,再与用户原始问题拼接后送入LLM生成答案。欧琳AI水槽内置超过15000种中西菜谱,正是基于这一技术实现个性化推荐-。

3. 设备智控的IoT协议栈

工业级AI厨房助手还需要打通与硬件设备的通信——通过统一IoT协议栈,实现AI决策到油烟机风量调节、灶具火力控制、蒸烤箱温度曲线执行的完整闭环-36。

4. 智能体编排框架

复杂场景下需要多个AI模块协同工作(识别→检索→规划→执行),目前LangGraph已成为构建此类有状态、可恢复的智能体系统的主流框架,通过图结构建模节点执行与条件跳转,支持多智能体协作与持久化执行-。

七、高频面试题与参考答案

Q1:请简述AI厨房助手的核心技术架构包含哪些模块?

参考答案:AI厨房助手的核心技术架构通常包含四大模块:

多模态感知模块:通过视觉模型识别食材种类、状态,部分方案结合热成像/重量传感器实现多维度感知。

RAG检索模块:从向量化知识库(菜谱库、食材数据库)中检索与用户需求匹配的信息。

大语言模型生成模块:基于感知结果与检索内容,生成个性化菜谱和烹饪指导。

设备协同智控模块:通过IoT协议栈将AI指令下发到油烟机、灶具、烤箱等硬件设备,实现全链路闭环。

Q2:RAG相比纯LLM生成的优势是什么?

参考答案:RAG的核心优势有三点:

准确性更高:基于真实知识库检索,减少模型“幻觉”问题;

知识可更新:知识库更新即可生效,无需重新训练模型;

私域数据利用:可对接企业私有菜谱库、用户偏好档案,实现真正的“千人千面”。如老板电器食神大模型构建了300万+菜谱、2.4万种食材特性的高精度知识库,正是RAG技术的典型应用-36。

Q3:多模态大模型与纯文本大模型在厨房场景中的本质区别是什么?

参考答案:本质区别在于感知维度的差异。纯文本大模型只能处理文字输入,无法“看到”真实食材;而多模态大模型能够同时处理图像+文本输入,实现“看图识菜”,识别老母鸡与肉鸡的差别、判断番茄成熟度等。这使AI厨房助手从“盲人问诊”升级为“眼见为实”。

Q4:如何解决AI厨房助手生成菜谱的个性化问题?

参考答案:主要从三个层面解决:

私域知识注入:通过RAG检索用户的个人饮食偏好、过敏史、健康数据(如血糖值);

用户反馈学习:记录用户对推荐菜谱的评分和修改行为,动态优化推荐权重;

多轮对话交互:通过智能体框架实现上下文记忆,在后续推荐中主动避开用户不喜欢的食材和烹饪方式。

Q5:LangGraph在构建AI厨房助手中的作用是什么?

参考答案:LangGraph是一个支持状态管理的智能体编排框架,在AI厨房助手中的核心作用包括:

流程控制:通过图结构定义“识别→检索→生成→执行”的节点依赖和跳转逻辑;

状态持久化:支持多轮对话的上下文保存,实现“记忆式”交互;

多智能体协作:可构建“食材识别Agent”“菜谱检索Agent”“设备控制Agent”等分工协作的智能体系统-。

八、结尾总结

回顾全文核心知识点:

痛点驱动:传统菜谱App和纯LLM方案,分别受限于“静态知识库”和“缺乏视觉感知”两大瓶颈。

技术三支柱:多模态大模型(感知)+ RAG(检索)+ 设备智控(执行)构成了AI厨房助手的技术基座。

核心关系:多模态负责“看”,RAG负责“查”,大模型负责“想”——三者协同,缺一不可。

面试踩分点:回答时要明确区分纯LLM与RAG的差异、理解多模态感知的工程价值、能够简要说明检索原理与向量相似度计算。

易错点提醒:很多人容易把RAG和多模态混淆——记住:RAG解决的是“知识从哪里来”,多模态解决的是“信息怎么感知进来”,这是两个正交的技术维度。

下篇预告:本文聚焦AI厨房助手的“感知+检索”层面,下一篇将深入智能体编排方向,拆解LangGraph如何构建具备记忆、反思和多轮对话能力的厨房助手Agent,敬请期待。