本文首发于北京时间2026年4月9日,带你一文读懂PDF AI助手的完整技术栈。

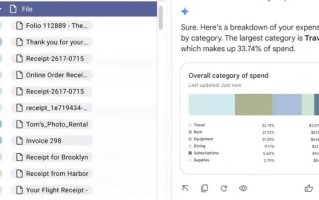

PDF AI助手正以惊人的速度从“PDF阅读器中的增值功能”进化为独立的智能生产力工具。2026年以来,无论是Adobe Acrobat上线AI智能体与跨文档图表生成能力,还是UPDF正式发布AI Agents版本,乃至LightOn推出参数量仅10亿但性能世界领先的端到端OCR模型LightOnOCR-2,整个赛道正在经历从“能对话”到“能理解”的技术跃迁-20-24-4。对于技术学习者和开发者而言,理解PDF AI助手的底层原理,已不仅是应付面试的需要,更是把握AI应用落地的关键入口。

但许多学习者面临同样的问题:知道“上传PDF→问问题→AI回答”这个流程,却不清楚PDF是如何被“读懂”的;听说过RAG和向量检索,却搞不懂这几个概念之间的逻辑关系;到面试时被问“PDF AI助手的技术架构是怎样的”,要么答得太浅显,要么逻辑混乱。本文将从零开始,系统拆解PDF AI助手的核心技术链路,让你理解每一步“发生了什么”。

<h2 id="痛点切入:为什么PDF不能直接喂给大模型"></h2>先来看一个最朴素的想法——直接把PDF文件交给大语言模型(Large Language Model,LLM,即大语言模型)去读:

❌ 错误做法:PDF二进制流直接喂给LLM pdf_bytes = open("document.pdf", "rb").read() response = llm.chat("请总结这份PDF的主要内容", pdf_bytes) 结果:报错 或 输出“我无法理解您发送的PDF格式”

问题出在哪里?PDF本质上是一种版面描述格式,包含字体、坐标、图像、矢量图形等排版信息,而不是连续的文本流。LLM只接受文本输入(prompt)和少量多模态能力,直接丢二进制文件只会得到乱码或错误。

传统做法通常采用两步走:

❌ 传统做法:两步走 步骤1:用OCR/文本提取库读取PDF from PyPDF2 import PdfReader reader = PdfReader("document.pdf") text = "" for page in reader.pages: text += page.extract_text() 步骤2:将提取的纯文本喂给LLM response = llm.chat(f"请总结以下内容:{text}")

这种做法有三个致命缺陷:

版面结构丢失:多栏排版、表格、标题层级全被压成平铺文本。一篇学术论文的第二列内容可能和第一列混在一起,逻辑完全错乱。

OCR精度有限:扫描版PDF经过OCR(Optical Character Recognition,即光学字符识别)后,公式、特殊符号、手写批注的识别准确率大幅下降。

上下文窗口爆炸:一本500页的技术手册,纯文本动辄数十万字,直接塞进LLM的上下文窗口(即便是百万级Token的模型)既不经济也不高效,因为每次问答都要重新处理全部内容。

这正是PDF AI助手要解决的核心问题——它不是简单地把PDF当作文件传给AI,而是构建了一套从“非结构化PDF”到“可检索知识库”的完整处理链路。

<h2 id="核心概念讲解:RAG-检索增强生成"></h2>RAG(Retrieval-Augmented Generation,检索增强生成) 是PDF AI助手背后最核心的技术范式。通俗地说,RAG让AI不再“硬背”所有知识,而是教会它“翻书查资料”。

RAG的本质:从“记忆”到“查找+推理”

传统LLM的工作原理像一位参加闭卷考试的学生——所有知识都储存在参数中,无法实时查阅新资料,遇到训练数据中没有的内容就容易“编造”答案(俗称“幻觉”)。RAG把这个过程变成了开卷考试:

查资料:收到问题后,先去知识库中检索最相关的文档片段;

再作答:把查到的资料作为“参考素材”,连同原问题一起交给LLM,让模型基于事实材料生成回答-32。

这正是市面上ChatPDF、AskYourPDF等工具能在几秒内从百页文档中精准定位答案的核心原理-62。

RAG的标准流程

一个完整的RAG系统分为三个阶段-32:

文档预处理与向量化(离线阶段) :将PDF经过解析、分块、嵌入模型转换,存入向量数据库。

向量检索(在线阶段) :用户提问时,将问题同样转为向量,在向量数据库中查找最相似的文档块。

上下文增强生成(在线阶段) :将检索到的Top-K个最相关文档块作为上下文,连同问题一起提交给LLM生成最终答案。

理解RAG的“检索”环节,必须弄清楚三个紧密关联的概念。

嵌入

嵌入(Embedding) 是将文本、图像等非结构化数据转换为高维向量的技术。举个例子:

“PDF AI助手” → [0.23, -0.51, 0.87, …, 0.42](一个768维的浮点数数组)

“文档智能问答” → [0.21, -0.48, 0.91, …, 0.39](与上一个向量“相似”)

相似语义的文本会映射到向量空间中相近的位置——这就是向量检索能够“找相似内容”的原理。

向量

向量本质上是一个数学上的坐标点。想象一下二维平面:点(0,0)和点(1,1)之间的距离是1.41,点(1,1)和点(1,2)之间的距离是1。高维空间中原理相同,只是维度从2变成几百甚至上千。

两个向量的余弦相似度越高,代表两个文本的语义越接近-32。

向量数据库

向量数据库(如Milvus、Pinecone、Chroma)是专门为存储和检索高维向量而设计的数据库。与传统数据库按精确字段查询不同,向量数据库的核心能力是相似性——给定一个向量,快速找到数据库中最相似的前K个向量。

三者的关系:一句话总结

嵌入是将文本“翻译”成向量的工具,向量数据库是存放这些向量并支持快速查找的仓库。

PDF处理流程中,每段提取出来的文本都会通过嵌入模型转化为向量,存入向量数据库。用户提问时,问题经过同样的嵌入模型变成向量,再在数据库中找到语义最相近的文档块-29。

<h2 id="概念关系与区别总结:RAG-vs-向量数据库-vs-嵌入模型"></h2>这三者的逻辑关系必须理清,避免面试中“混着说”。

| 概念 | 类比 | 在PDF AI助手中的职责 |

|---|---|---|

| 嵌入模型 | “翻译官” | 将自然语言文本转化为高维向量 |

| 向量数据库 | “图书馆” | 存储向量并执行相似性检索 |

| RAG | “检索+生成”整体流程 | 串联嵌入、向量检索、LLM生成的全过程 |

一句话记住:嵌入模型把内容“编码”成向量,向量数据库“存储和”这些向量,RAG“串起”这一切并为LLM“提供资料”。

<h2 id="代码示例:搭建一个最小可用的PDF问答系统"></h2>下面用实际代码展示一个简化版的PDF AI问答系统,突出核心链路。

最小化PDF问答系统示例(使用LangChain + FAISS + OpenAI) 需提前安装:pip install langchain openai faiss-cpu pypdf from langchain.document_loaders import PyPDFLoader from langchain.text_splitter import RecursiveCharacterTextSplitter from langchain.embeddings import OpenAIEmbeddings from langchain.vectorstores import FAISS from langchain.chains import RetrievalQA from langchain.chat_models import ChatOpenAI 步骤1:加载PDF文档 ① 将PDF解析为可处理的文本 loader = PyPDFLoader("./document.pdf") 假设文件存在 documents = loader.load() print(f"✅ 共加载 {len(documents)} 页") 步骤2:文本分块(Chunking) ② 将长文本切分成大小合适的块(每块约500字符) text_splitter = RecursiveCharacterTextSplitter( chunk_size=500, 每块最大字符数 chunk_overlap=50 块与块之间重叠50字符,防止关键信息被切断 ) chunks = text_splitter.split_documents(documents) print(f"📝 文档被切分为 {len(chunks)} 个文本块") 步骤3:向量化并存入向量数据库 ③ 用嵌入模型将每个文本块转为向量 embeddings = OpenAIEmbeddings() vectorstore = FAISS.from_documents(chunks, embeddings) print(f"💾 已将 {len(chunks)} 个块存入向量数据库") 步骤4:构建RAG问答链 ④ 向量检索 + LLM生成 = RAG qa_chain = RetrievalQA.from_chain_type( llm=ChatOpenAI(model="gpt-3.5-turbo", temperature=0), chain_type="stuff", 将检索到的内容合并后送入LLM retriever=vectorstore.as_retriever(search_kwargs={"k": 3}) 每次检索Top-3最相关块 ) 步骤5:提问 question = "这份PDF的核心观点是什么?" answer = qa_chain.run(question) print(f"❓ {question}") print(f"🤖 {answer}")

代码关键点解析:

| 步骤 | 技术动作 | 对应RAG阶段 |

|---|---|---|

| ① | PyPDFLoader加载 | PDF解析 |

| ② | text_splitter分块 | 文档预处理 |

| ③ | OpenAIEmbeddings + FAISS | 向量化 + 存储 |

| ④ | RetrievalQA链 | RAG融合(检索+生成) |

实际生产环境中的PDF AI助手比上述示例复杂得多,但核心逻辑完全一致。

<h2 id="底层原理技术支撑点"></h2>RAG和向量检索能跑通,离不开几个底层技术。PDF AI助手的性能瓶颈往往不来自大模型本身,而来自预处理环节。

PDF解析框架对比

近期一项学术研究系统对比了Docling、MinerU、Marker和DeepSeek OCR四种开源PDF转Markdown框架,在1,706页、约49万词的葡萄牙语行政文档语料上进行了评估。结果显示:

朴素PDFLoader基线仅86.9%准确率,而人工标注的Markdown达到97.1%。

Docling配合层级分块和图像描述后达到94.1%,位居自动化方案榜首。

元数据增强和层级感知分块对准确率的贡献甚至超过了转换框架本身的选择。

基于字体的层级重建方案始终优于基于LLM的方案-1。

这些数据有力说明了:PDF预处理质量是RAG系统性能的主导因素,而非模型大小或提示词技巧。

2026年关键技术突破

端到端视觉语言模型OCR:LightOnOCR-2仅10亿参数,却在OlmOCR基准上超越9倍于其规模的模型,端到端架构无需传统OCR多阶段流水线,速度达Chandra OCR的3.3倍-4。

多模态RAG:ColQwen2等技术将PDF页面作为图像直接编码,绕过传统OCR+文本分块步骤,保留表格、图表、公式等视觉信息,检索时返回完整页面图像而非零散文本片段-30。

PDF问答基准测试:苏黎世大学等联合推出的pdfQA数据集包含4,000组问答对、覆盖10级复杂度,当前最强开源LLM在该基准上F1仅42.7%-64。

这些进展揭示了一个趋势:PDF解析正从传统的字符识别走向端到端的视觉语义理解,多模态能力将成为下一阶段竞争的核心战场。

<h2 id="高频面试题与参考答案"></h2>以下是关于PDF AI助手的3道高频面试题。

面试题1:请解释RAG与微调(Fine-tuning)的区别,以及在PDF问答场景中为什么更倾向于使用RAG?

参考答案:

微调:将领域知识注入LLM的参数中,训练成本高,且难以处理动态更新的文档库。

RAG:不改变模型参数,而是在推理时从外部知识库中动态检索相关信息-32。

在PDF问答场景中选择RAG的原因:①PDF库经常更新,RAG无需重新训练;②RAG可以明确引用原文出处,提升可解释性;③私有文档无需上传到训练服务器,满足数据合规要求;④实施成本和迭代周期远低于微调。

面试题2:构建一个PDF智能问答系统时,处理流程中的最大技术挑战是什么?如何优化?

参考答案:

最大挑战是文档预处理。研究表明,数据处理质量对RAG系统性能的影响超过模型选择-1。

优化策略包含三个层面:

解析层面:选用支持版面感知的解析框架(如Docling、MinerU),而非简单的PyPDF2。针对扫描版PDF,使用VLM(视觉语言模型)级OCR而非传统Tesseract。

分块策略:采用层级感知分块——基于字体大小和缩进重建标题层级,将同一章节的内容保持在语义连贯的块中,而非机械地按固定字符数切分。设置15%–20%的文本重叠窗口,防止关键信息被切断-32。

检索优化:引入重排序(Reranking)机制——先用向量检索召回Top-20候选块,再用轻量级重排序模型(如Cohere Rerank)按相关性重新打分,可提升准确率20%–40%-32。

面试题3:向量数据库在PDF AI助手中起什么作用?与传统数据库有何不同?

参考答案:

核心作用:存储和检索PDF文档切片的高维向量表示,支撑语义级别的相似性。

与传统数据库的区别:传统数据库基于精确匹配(如WHERE id=123),向量数据库基于近似最近邻(Approximate Nearest Neighbor, ANN),不要求精确匹配,而是找到语义上最相似的Top-K个向量-32。

在PDF场景中的优势:用户问“合同的违约金条款”,传统数据库需要精确命中“违约金”关键词才能返回,而向量数据库能够理解“违约责任”“赔偿条款”“penalty clause”等同义表达并返回相关文档块。

本文从传统PDF处理的痛点出发,系统拆解了PDF AI助手背后的完整技术链路:

RAG是整体架构,实现了“先检索后生成”的范式。

嵌入模型将文本“翻译”为高维向量。

向量数据库为向量提供快速相似性能力。

PDF解析质量是决定RAG系统性能的核心瓶颈。

关键数据速记:Docling+层级分块达94.1%自动化准确率;pdfQA基准上开源LLM仅42.7% F1;LightOnOCR-2仅10亿参数超越9倍规模竞品。

面试核心考点:RAG与微调的区别、向量数据库与传统数据库的区别、PDF预处理的优化策略。

PDF AI助手的技术赛道正从“能对话”向“能理解”快速演进。下一篇文章将深入解析多模态RAG技术,探讨如何让AI同时“看懂”PDF中的表格、图表和扫描批注,敬请期待。