在生成式AI从“模型越大越好”转向“响应越快越好”的2026年,cerebr AI助手凭借晶圆级推理架构实现了超3000 tokens/秒的推理速度,彻底打破了大模型“快不起来”的瓶颈。本文将从原理、代码到面试题,系统拆解这项让AI编程助手真正“跟得上你思路”的核心技术。

📌 关于“cerebr”命名的说明:在AI生态中,“cerebr”一词源自拉丁语“大脑”的词根,常出现在以智能和认知为核心命名的技术项目中。本文聚焦的Cerebras公司——其晶圆级推理平台正是2026年推动AI助手性能飞跃的核心力量——其名同样源于此。

一、痛点切入:为什么AI助手总是“跟不上”?

先看一个典型的传统实现——开发者想用大模型辅助写一段代码:

传统方案:直接调用云端大模型API import requests response = requests.post( "https://api-gpu-provider.com/v1/chat/completions", json={"model": "llama-70b", "messages": [{"role": "user", "content": "用Python写一个快速排序"}], "stream": False} ) print(response.json()["choices"][0]["message"]["content"])

这段代码有两个致命痛点:一是每次请求动辄等待数秒甚至十几秒,开发思路经常被“卡断”;二是传统GPU架构在推理时,每个token的生成都需要从显存中读取整个模型权重,内存带宽成为系统性瓶颈-1。当AI编程助手需要生成1500+ tokens的长代码时,开发者不得不面对“输入提示→干等半分钟→看结果”的低效循环。

这正是cerebr AI助手要解决的核心问题——通过硬件层面的架构重构,让AI推理从“分秒级”跨入“毫秒级”。

二、核心概念讲解:晶圆级推理架构

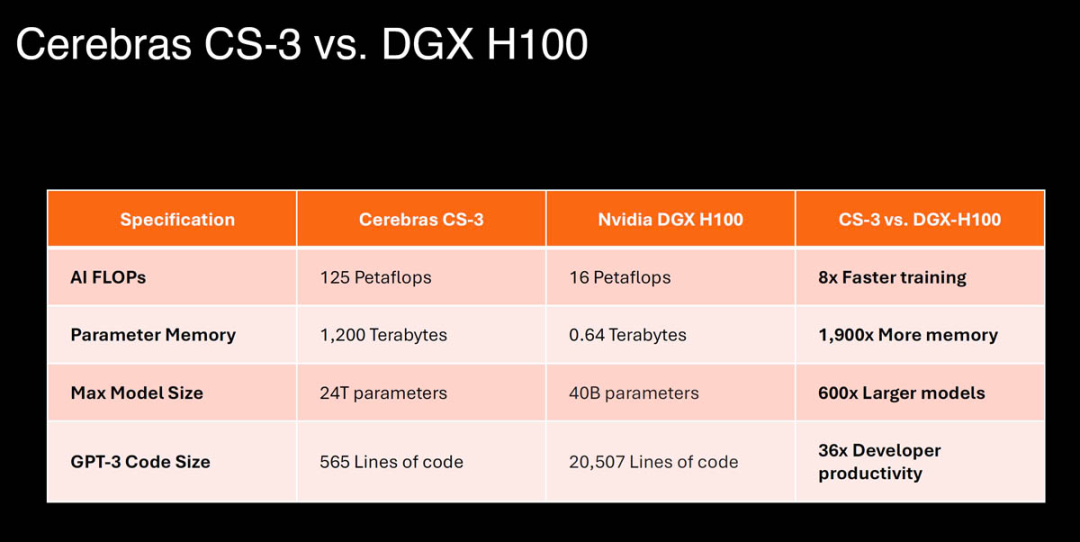

晶圆级推理(Wafer-Scale Inference) :Cerebras的CS-3系统将AI模型的所有权重直接存储在芯片上的SRAM(静态随机存取存储器)中,而非依赖GPU的外部HBM内存-。SRAM的速度比英伟达Rubin GPU中的HBM4内存快约1000倍,这意味着每次推理时,数据获取的“等待时间”被压缩到极致--。

一个类比理解:传统GPU做推理就像去一个超大图书馆查资料——每问一个问题都要从库房里调取整本书,来回跑动极其耗时。而cerebr AI助手则相当于把整本书摊开放在书桌上,每次翻页只需移动目光,几乎零延迟。

三、关联概念讲解:Prefill与Decode的解耦推理

在AI推理中,每个请求包含两个阶段:

Prefill(预填充阶段) :读取并理解用户输入的提示词,这是一个计算密集型操作,需要大量算力但内存带宽需求不高。

Decode(解码阶段) :逐字生成回答,每生成一个token都需要从内存中获取整个模型权重,是带宽密集型操作-1。

传统方案将两个阶段混在同一芯片上执行,造成资源浪费。cerebr AI助手的解耦推理架构将Prefill分配给AWS Trainium芯片处理,将Decode交给Cerebras CS-3执行,两者通过EFA高速互联连接。这种分工使解码阶段的token吞吐量提升5倍-1。

| 维度 | 传统GPU方案 | cerebr解耦推理 |

|---|---|---|

| Prefill | 共用芯片 | Trainium专用芯片 |

| Decode | 共用芯片 | Cerebras CS-3专用 |

| 互连延迟 | 高 | EFA高速互联 |

| 解码吞吐 | 基准线 | 5倍提升 |

四、概念关系总结

一句话记忆:晶圆级推理是“怎么存”的硬件设计,解耦架构是“怎么跑”的调度策略——前者解决内存带宽瓶颈,后者解决计算资源错配。

晶圆级推理 → 决定数据的“存储位置”,解决访存慢的问题

解耦推理 → 决定任务的“分工方式”,解决资源浪费的问题

两者协同:先用晶圆级架构把模型“搬到”高速片上内存,再用解耦分工让每个芯片干最擅长的活

五、代码示例:三步接入cerebr AI助手

5.1 Java客户端示例

// Step 1: 获取API密钥(从cloud.cerebras.ai申请) String apiKey = System.getenv("CEREBRAS_API_KEY"); // Step 2: 构建请求体 String requestBody = """ { "model": "llama3.1-70b", "messages": [{"role": "user", "content": "用Python写一个快速排序"}], "temperature": 0.2 } """; // Step 3: 发送请求,接收超快响应 HttpRequest request = HttpRequest.newBuilder() .uri(URI.create("https://api.cerebras.ai/v1/chat/completions")) .header("Authorization", "Bearer " + apiKey) .POST(HttpRequest.BodyPublishers.ofString(requestBody)) .build(); HttpResponse<String> response = HttpClient.newHttpClient().send(request, ...);

与传统方案的对比一目了然:API调用方式几乎一致,但底层的CS-3硬件带来了高达15倍的推理速度提升-2-。

5.2 Python深度研究助手示例

更完整的Agent实现——构建一个Perplexity风格的深度研究助手-12:

安装依赖 pip install exa-py cerebras-cloud-sdk from cerebras.cloud.sdk import Cerebras from exa_py import Exa 初始化客户端 client = Cerebras(api_key=CEREBRAS_API_KEY) exa = Exa(api_key=EXA_API_KEY) 网络 + AI分析 def search_web(query, num=5): return exa.search_and_contents(query, type="auto", num_results=num) def ask_ai(prompt): chat = client.chat.completions.create( messages=[{"role": "user", "content": prompt}], model="zai-glm-4.7", temperature=0.2 ) return chat.choices[0].message.content 完整的研究流程: → 采集 → AI分析 → 生成结论

这段代码的核心价值在于:AI Agent在执行多步骤任务(→采集→分析→总结)时,每一步都需要调用LLM。cerebr超快推理让整个链式任务在60秒内完成,而传统方案可能需要数分钟-12。

六、底层原理与技术支撑

cerebr AI助手的性能飞跃,根植于晶圆级引擎WSE-3的硬件创新:

片上SRAM存储:整个模型权重存放在芯片内部SRAM中,而非外部内存。SRAM的速度比GPU常用的HBM内存快约1000倍-。

消除通信瓶颈:传统GPU集群中,数据需要在多个芯片间传输,跨芯片通信成为性能瓶颈。晶圆级架构将整个系统集成在一张晶圆上,数据通路大幅缩短-37。

硬件-软件协同设计:推理管道针对SRAM特性做了深度优化,让每个时钟周期都物尽其用-。

实测数据:Cerebras CS-3运行GPT-OSS-120B时达到约2988 tokens/秒,而英伟达Blackwell B200 GPU仅约900 tokens/秒;处理10个并行请求时,差距进一步扩大到2700+ vs 580 tokens/秒-37-。

七、高频面试题与参考答案

Q1:Cerebras晶圆级架构与传统GPU架构的核心区别是什么?

参考回答:传统GPU通过互联多个小芯片组成集群,面临通信带宽瓶颈和内存延迟问题。Cerebras采用晶圆级架构(Wafer-Scale Engine),将整个模型权重存储在芯片内部的SRAM片上内存中,消除了数据在芯片间传输的瓶颈。SRAM速度比HBM内存快约1000倍,这也是Cerebras能实现3000+tokens/秒推理速度的根本原因。--

Q2:Prefill和Decode阶段为什么需要解耦处理?

参考回答:Prefill是计算密集型,处理用户输入的提示词;Decode是带宽密集型,每生成一个token都要访问完整模型权重。两者资源需求截然不同,混在同一芯片上必然有资源浪费。Cerebras与AWS合作的解耦架构将Prefill交给Trainium芯片、Decode交给CS-3芯片,通过高速EFA互联,使解码吞吐量提升5倍。-1

Q3:Cerebras晶圆级推理解决了AI助手的什么核心痛点?

参考回答:AI编程助手等场景中,一个查询可能生成1500+ tokens(是普通聊天的约15倍),传统GPU推理的逐token延迟严重打断开发思路。Cerebras将推理速度从数百tokens/秒提升至3000+tokens/秒,使实时代码生成成为可能。OpenAI与Cerebras的合作已实现每秒1000 tokens的编程反馈。-1-

Q4:在Agent开发中,cerebr AI助手的推理速度带来了什么价值?

参考回答:现代AI Agent需要多次调用LLM才能完成复杂任务。以长文档问答为例,Agent需要分页、总结、检索、回答——数十次顺序LLM调用。如果每次推理耗时数秒,整个流程将超过1分钟,严重影响交互体验。cerebr的超快推理将单次调用压缩到毫秒级,使多步Agent工作流真正达到实时响应。-29

Q5:Cerebras与主要竞品的性能对比如何?

参考回答:以GPT-OSS-120B模型为例,Cerebras CS-3约2988 tokens/秒,Together.ai约917 tokens/秒,英伟达Blackwell B200约900 tokens/秒,处理10个并行请求时优势更明显(2700+ vs 580 tokens/秒)。价格方面,Cerebras约0.45美元/百万tokens,在高吞吐场景中性价比优势突出。-37

八、结尾总结

本文围绕cerebr AI助手的技术内核,梳理了以下核心知识点:

痛点识别:传统AI助手慢在内存带宽瓶颈和推理阶段资源错配

核心概念:晶圆级推理将模型权重放在片上SRAM中,消除通信瓶颈

关联概念:Prefill与Decode的解耦处理,实现5倍解码吞吐量提升

概念关系:晶圆级架构解决“怎么存”,解耦架构解决“怎么跑”

实战代码:Java/Python SDK三步接入,Agent多步调用实时完成

底层支撑:WSE-3硬件、SRAM片上存储、硬件-软件协同设计

⚠️ 重点提醒:面试中常将“晶圆级架构”与“解耦推理”混为一谈——记住前者是硬件存储设计,后者是任务调度策略,二者互补而非替代。

技术演进预判:2026年AI竞赛的主战场正从训练规模转向推理速度-。OpenAI已与Cerebras签署超100亿美元的合作,将在2026-2028年间部署总计750兆瓦的晶圆级系统-。这意味着,未来的AI助手将从“会思考”进化为“能实时交互”——而cerebr AI助手的晶圆级推理技术,正是这场进化的核心引擎。