北京时间:2026年4月10日

清晨唤醒智能音箱查天气、开车时用语音助手导航、接听AI客服电话……AI的语音助手已渗透到我们日常生活的方方面面。然而对大多数开发者来说,这类产品仍然是一个“黑箱”——能调用API让它说话,却说不清它背后是怎么运作的;遇到面试官问“AI说话太慢怎么优化”时,更是无从答起。

本文将从零开始,一步步拆解AI语音助手的技术原理:先分析传统方案的问题痛点,再深入讲解自动语音识别(ASR,Automatic Speech Recognition) 、自然语言理解(NLU,Natural Language Understanding)和语音合成(TTS,Text-to-Speech)三大核心模块,梳理它们之间的协作关系,最后用可运行的代码示例展示如何从零构建一个最小化的语音助手,并附上高频面试题解析,帮读者真正建立起从“听得见”到“听得懂”再到“说得对”的完整知识链路。

一、痛点切入:传统“规则式”方案为什么不灵了?

1.1 传统的语音交互实现方式

以早期智能家居场景为例,开发者通常这样实现语音指令处理:

传统关键词匹配式语音助手(伪代码) def process_voice_command(text): 关键词硬编码匹配 if "开灯" in text or "打开灯" in text: turn_on_light() return "好的,已为您开灯" elif "关灯" in text: turn_off_light() return "好的,已为您关灯" elif "播放" in text and "音乐" in text: play_music() return "正在为您播放音乐" else: return "抱歉,我没听懂您的指令"

这段代码本质上就是一个关键词匹配的规则树——用户输入什么文本,系统就去查找关键词,匹配上了就执行对应动作。

1.2 传统方案的痛点

这种实现方式存在明显缺陷:

表达僵化,容错性差:用户说“把灯打开”“帮我亮一下灯”“房间里太暗了”,系统都无法识别,因为关键词不在预设规则中-2。

扩展性差,维护成本高:每增加一个功能就要往if-else里添代码,系统越做越大、越来越乱。

无法处理多轮对话:用户说“今天天气怎么样?那明天呢?”,系统完全不知道“明天”指的是什么-50。

缺乏上下文记忆:用户说“把空调调到26度”后又说“把它调低点”,系统无法理解“它”指的是什么。

这些痛点催生了新一代基于深度学习和大模型的语音交互方案。2026年,语音机器人技术已进入“大模型融合时代”,大语言模型被深度融合到语音交互系统中,具备了强大的语义理解和多轮对话能力-2。

二、核心概念讲解:ASR——AI语音助手的“耳朵”

2.1 标准定义

自动语音识别(ASR,Automatic Speech Recognition) 是将人类语音信号转换为计算机可处理的文本序列的技术。简单说,就是让机器“听懂”人类说的话-49。

2.2 工作原理拆解

ASR的工作流程可以分为四个阶段:

第一步:音频采集与预处理

麦克风捕获语音信号后,系统进行降噪和增强。现代方案采用麦克风阵列技术,配合自适应降噪算法,可在80dB噪声环境下保持95%以上的唤醒率-1。

第二步:特征提取

将预处理后的音频信号转换为特征向量——可理解为语音的“数字指纹”,将连续的音频压缩为计算机容易处理的形式。

第三步:声学模型识别

采用端到端深度学习模型(如Conformer、Whisper等架构)将特征向量映射到音素等语音单元-39。当前领先的ASR系统在安静环境下的字错率已低于5%-50。

第四步:语言模型解码

语言模型根据上下文信息,预测最可能的文字序列,大幅提升识别准确率-49。例如识别到“我想查”时,语言模型会预测下一个词可能是“天气”“快递”等。

2.3 2026年ASR的关键指标

根据2026年行业数据,优秀ASR系统的核心指标如下-2:

| 指标 | 良好水平 | 优秀水平 |

|---|---|---|

| 安静环境识别准确率 | ≥97% | ≥99% |

| 75dB噪声环境准确率 | ≥90% | ≥95% |

| 远场拾音距离 | 5米 | 10米 |

| 响应延迟 | <500ms | <300ms |

三、关联概念讲解:NLP与NLU——让机器“理解”语义

3.1 标准定义

自然语言处理(NLP,Natural Language Processing) 是让计算机理解、解释和生成人类语言的AI分支-49。在语音助手中,自然语言理解(NLU,Natural Language Understanding) 是NLP的核心子任务,专门负责解析文本的深层语义-50。

3.2 NLU的核心任务

领域识别:判断用户意图属于哪个领域(音乐、天气、设备控制等)

意图识别:确定用户的具体目的是询问、指令还是闲聊

槽位填充:提取关键参数(时间、地点、人名等)

以用户说“播放周杰伦的晴天”为例:系统需识别领域为“音乐”,意图为“播放歌曲”,并提取歌曲名“晴天”和歌手“周杰伦”两个关键参数-50。

3.3 对话管理(DM,Dialog Management)

仅理解单句话还不够,维持连贯对话还需要对话管理系统。它负责记录上下文并决定应答策略,通过对话状态追踪维护当前对话的上下文信息,如已提及的实体与用户偏好-50。

3.4 语音合成(TTS,Text-to-Speech)

TTS是AI语音助手的“嘴巴”,负责将计算机生成的文本转换为自然、流畅的语音输出-49。当前领先的TTS系统采用神经网络合成,自然度接近真人,并提供300种以上音色库,支持情感化语音输出与实时音调调整-1。

四、概念关系与区别总结:听懂-理解-回应三步曲

ASR、NLU、TTS三者构成完整的语音交互闭环:ASR是“耳朵”负责听清,NLU是“大脑”负责理解,TTS是“嘴巴”负责说话-49。

这个理解框架非常重要:ASR解决“说什么”,NLU解决“什么意思”,TTS解决“怎么回”。三者紧密协作,才能实现真正的自然交互。

五、代码/流程示例:构建一个最小化AI语音助手

5.1 系统架构

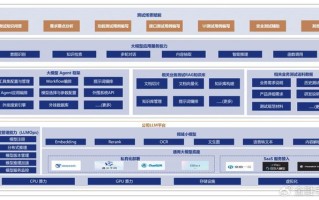

现代语音AI系统通常采用分层模块化架构,核心流程为:音频输入 → VAD(语音活动检测) → ASR → LLM/NLU → TTS → 音频输出-21。

VAD(Voice Activity Detection,语音活动检测) 是流水线的第一个组件,用于检测用户何时开始说话,避免将静音或环境噪声误当作语音输入。

5.2 Python极简实现

以下示例基于百度语音API和图灵机器人API,展示如何用Python构建一个完整的最小化语音助手-57:

最小化AI语音助手实现(基于API方式) import requests import base64 import pyaudio import wave ========== 1. 语音识别(ASR):将语音转为文本 ========== def speech_to_text(audio_data, api_key, secret_key): 获取Access Token token_url = f"https://aip.baidubce.com/oauth/2.0/token" token_resp = requests.get(token_url, params={ "grant_type": "client_credentials", "client_id": api_key, "client_secret": secret_key }).json() access_token = token_resp["access_token"] 调用ASR接口 asr_url = f"https://vop.baidu.com/server_api?token={access_token}" data = { "format": "wav", "rate": 16000, "channel": 1, "speech": base64.b64encode(audio_data).decode("utf-8"), "len": len(audio_data) } resp = requests.post(asr_url, json=data).json() return resp["result"][0] if resp.get("result") else "" ========== 2. 语义理解(NLU)+ 对话生成 ========== def get_ai_response(text, api_key): """调用图灵机器人API获取智能回复""" url = "http://openapi.tuling123.com/openapi/api/v2" payload = { "reqType": 0, "perception": {"inputText": {"text": text}}, "userInfo": {"apiKey": api_key, "userId": "voice_assistant"} } resp = requests.post(url, json=payload).json() return resp.get("results", [{}])[0].get("values", {}).get("text", "抱歉,我没理解您的问题") ========== 3. 语音合成(TTS):将文本转为语音 ========== def text_to_speech(text, api_key, secret_key): 获取Access Token(复用上面逻辑) access_token = get_access_token(api_key, secret_key) tts_url = f"http://tsn.baidu.com/text2audio?tex={text}&tok={access_token}&cuid=xxx&ctp=1&lan=zh" audio_resp = requests.get(tts_url) return audio_resp.content ========== 4. 主流程:录制 → 识别 → 理解 → 合成 → 播放 ========== def main(): 录制语音(PyAudio实现,此处省略具体录音代码) audio_bytes = record_audio(duration=3) 录制3秒 ASR:语音转文本 user_text = speech_to_text(audio_bytes, API_KEY, SECRET_KEY) print(f"用户说: {user_text}") NLU:语义理解与回复生成 ai_text = get_ai_response(user_text, TULING_API_KEY) print(f"AI回复: {ai_text}") TTS:文本转语音并播放 audio_output = text_to_speech(ai_text, API_KEY, SECRET_KEY) play_audio(audio_output)

5.3 新旧实现方式对比

| 维度 | 传统规则式 | 现代AI驱动式 |

|---|---|---|

| 表达方式 | 关键词硬编码 | 语义理解+上下文 |

| 扩展性 | 手动添加if-else | API集成,即插即用 |

| 多轮对话 | 不支持 | 支持上下文追踪 |

| 开发效率 | 低 | 高 |

六、底层原理/技术支撑:2026年语音AI的核心突破

6.1 从级联架构到端到端大模型

传统语音助手采用“ASR + NLU + TTS”的级联架构,各模块独立运作,存在信息丢失和延迟累积的问题。到了2026年,端到端语音大模型正在取代拼凑式的级联方案,响应时延压缩至0.7秒以内-23。阿里巴巴在2026年3月30日发布的Qwen3.5-Omni就是一个典型代表——它能在单一模型中统一处理文本、图像、音频和视频,并同时输出文本和实时语音-。

6.2 Agent化趋势

2026年的语音机器人不再只是“会说话的菜单”,而是具备通过API操作业务系统能力的Agent,让机器人拥有了真正可以“办事”的“手”和“脚”-23。基于Agent架构,单集群可支撑5万路并发呼叫,系统可用性达到99.99%-5。

6.3 底层依赖的技术基础

语音AI系统的底层离不开以下技术支撑:

深度学习框架:PyTorch、TensorFlow等提供模型训练与推理能力

WebRTC实时通信协议:实现低延迟的双向语音传输-5

向量数据库:RAG(检索增强生成)知识库的核心,用于高效语义检索

分布式系统架构:支持高并发、弹性伸缩-5

七、高频面试题与参考答案

Q1:请简述AI语音助手的核心技术架构和主要流程。

参考答案:AI语音助手采用“ASR + NLU + DM + TTS”的分层架构。核心流程分五步:①麦克风采集语音信号;②ASR将语音转成文本;③NLU进行领域识别、意图识别和槽位填充;④对话管理(DM)结合上下文生成回复文本;⑤TTS将回复文本合成为语音输出-49。

Q2:AI语音交互延迟过高如何优化?请给出具体方案。

参考答案:可采用“流式分句合成”与“首句秒开”策略。不等LLM生成完整回复,只要生成前20个字(一个完整句子),就立即交给TTS合成播放。用户在听第一句时,AI在后台继续生成后续内容,体感延迟可从2秒降至280ms-52。

Q3:如何防止AI语音助手在专业场景下“胡言乱语”?

参考答案:构建RAG(检索增强生成)知识库。用户提问时,系统先去向量数据库(如Milvus)检索相关知识,然后将检索结果作为上下文约束提供给LLM,要求“只根据这段话回答”,可将准确率从70%提升至91%以上-52。

Q4:用户说话中途打断AI如何处理?

参考答案:实现“双工打断监测机制”。前端监测到用户新的语音输入后,立即通过WebSocket发送STOP信号;后端收到信号后立刻掐断LLM的生成流,同时停止Token消耗以节省成本-52。

八、结尾总结

本文从传统规则式方案的痛点出发,系统拆解了AI语音助手的技术架构:ASR解决“听得见”的问题,NLU赋予“理解”能力,TTS完成“回应”输出,三者通过级联或端到端的方式协同工作,形成完整的交互闭环。2026年,语音AI正经历从“级联架构”到“端到端大模型”、从“问答式”到“Agent化”的重大变革,响应时延压缩至0.7秒以内,并发能力提升10倍。

本文属于“AI语音助手技术深度解析”系列第一篇。下一篇将深入讲解RAG知识库的构建与优化,包括向量数据库选型、检索策略调优和实时知识更新机制,帮助读者进一步掌握语音AI在专业场景下的落地方法。