一、开篇引入:为什么每位开发者都要懂大模型

在当前AI技术体系中,大语言模型(Large Language Model,简称LLM) 无疑占据着核心位置。许多学习者面临着共同的痛点:会用ChatGPT之类的产品,却说不清其背后的Transformer架构原理;能调API做简单应用,面试时却答不出Attention机制如何工作;谈起RAG、Agent、微调等概念时,概念之间界限模糊,表述混乱。这些困境,恰恰说明“会调用”不等于“懂原理”。

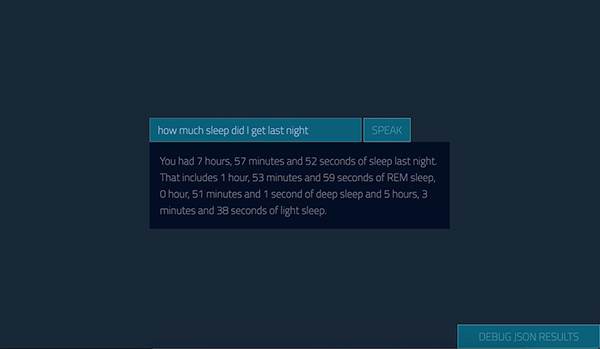

本文将聚焦睡眠AI助手这一典型场景,带你从零理解大模型的核心概念、底层架构与开发实践。全文遵循“问题→概念→关系→示例→原理→考点”的逻辑主线,既有原理讲解,也有代码示例和面试要点,帮你建立完整的知识链路。

二、痛点切入:为什么需要睡眠AI助手?

先来看传统睡眠监测的实现方式:

传统方式:硬编码阈值判断 def analyze_sleep_old(data): 手动提取心率、呼吸等指标 heart_rate = data['heart_rate'] 用固定阈值判断睡眠质量 if heart_rate < 60: quality = "深度睡眠" elif heart_rate < 75: quality = "浅度睡眠" else: quality = "清醒" return quality

传统方案的痛点在于:

耦合高:逻辑与数据格式强绑定,换一种传感器就需要重写代码

扩展性差:新增疾病预测维度时,需要手动添加if-else分支

维护困难:个体差异导致统一阈值失效,千人一面的判断结果不准确

这就引出了AI大模型介入的必要性:大模型能够自动从海量数据中学习复杂模式,实现个性化、精准化的睡眠健康分析。

三、核心概念讲解:大语言模型(LLM)

标准定义

大语言模型(Large Language Model,LLM) 是指参数量巨大、在大量文本数据上训练而成的深度学习模型,具备强大的语言理解与生成能力。

关键词拆解

“大”:体现在参数量、训练数据和计算资源三个维度。以DeepSeek-R2为例,其总参数量达到约1.2万亿,但推理时仅激活约780亿参数,通过MoE架构实现了“大容量、低计算”-。

“语言”:LLM本质上学习的是语言的统计规律与语义表征,能够理解上下文、捕捉隐含逻辑。

“模型”:以Transformer架构为技术底座,通过自注意力机制(Self-Attention) 动态计算词与词之间的关联权重,突破了传统RNN的顺序处理限制-。

生活化类比

可以把LLM理解为一位博览群书、博闻强识的“图书馆管理员”。你向他提问(输入Prompt),他先在脑海中检索相关书籍内容,然后组织成连贯的回答(生成输出)。他记得所有读过的书,但每次回答只需要调用部分知识——这恰好对应了MoE架构中“总参数量大、激活参数量小”的设计理念。

四、关联概念讲解:Transformer架构

标准定义

Transformer是2017年由Google提出的深度学习架构,核心创新在于完全基于注意力机制(Attention Mechanism) ,摒弃了传统循环神经网络(RNN)的递归结构。

与LLM的关系

Transformer是LLM的技术底座,LLM是Transformer在巨量数据和参数量下的规模化应用。简言之:LLM = Transformer架构 + 大规模训练。

关键机制解析

Transformer的核心计算过程如下:

自注意力计算:输入序列通过线性变换生成Q(Query)、K(Key)、V(Value)三个矩阵,计算注意力分数 = Q×Kᵀ/√d_k,再经Softmax加权聚合V-21

多头并行:将Q、K、V拆分为多个头(如DeepSeek使用16头),每个头在不同子空间捕捉信息,结果拼接后输出-21

位置编码:采用旋转位置嵌入(RoPE,Rotary Position Embedding) ,将位置信息编码入旋转矩阵,解决长序列中的位置感知问题-21

运行机制示例

简化的自注意力计算(伪代码) def self_attention(Q, K, V, d_k): Step 1: 计算注意力分数 scores = Q @ K.T / sqrt(d_k) 缩放点积,防止梯度消失 Step 2: Softmax归一化 attention_weights = softmax(scores) Step 3: 加权聚合 output = attention_weights @ V return output

五、概念关系与区别总结

| 维度 | LLM(大语言模型) | Transformer(架构) |

|---|---|---|

| 层次 | 应用/模型层 | 技术架构层 |

| 关系 | Transformer的具体实例化 | LLM的技术基础 |

| 核心 | 大规模参数 + 海量训练数据 | 自注意力机制 + 并行计算 |

| 类比 | “图书馆管理员” | “大脑的工作机制” |

一句话记忆:Transformer是“怎么算”的方法论,LLM是“算出来”的成品。

六、代码示例:用DeepSeek API构建睡眠分析助手

环境准备

安装依赖 pip install openai from openai import OpenAI 初始化客户端(使用DeepSeek API) client = OpenAI( api_key="your_deepseek_api_key", base_url="https://api.deepseek.com/v1" ) def sleep_analysis_agent(user_description): """睡眠分析助手:基于用户描述生成个性化睡眠报告""" Step 1: 构建Prompt(提示词工程) system_prompt = """你是一位专业的睡眠健康顾问。 请根据用户提供的睡眠描述,从以下几个维度进行分析: 1. 睡眠时长评估 2. 入睡困难程度 3. 睡眠质量评分(0-100分) 4. 改善建议(3条) 请以JSON格式返回结果。""" Step 2: 调用LLM API response = client.chat.completions.create( model="deepseek-chat", DeepSeek对话模型 messages=[ {"role": "system", "content": system_prompt}, {"role": "user", "content": user_description} ], temperature=0.7, response_format={"type": "json_object"} 要求结构化输出 ) Step 3: 解析返回结果 return response.choices[0].message.content 示例调用 result = sleep_analysis_agent( "我昨晚躺在床上2小时才睡着,半夜醒了3次,总睡眠时间大约5小时,白天很困。" ) print(result)

关键步骤注解

System Prompt设计:角色设定 + 任务分解 + 输出格式约束,是工程落地的核心

API调用:选择合适模型(chat/completion接口),配置temperature控制随机性

结构化输出:

response_format要求JSON格式,便于下游业务系统集成

对比效果

相比传统硬编码,AI方案的优势一目了然:

| 维度 | 传统规则引擎 | AI大模型方案 |

|---|---|---|

| 个性化能力 | 固定阈值,千人一面 | 根据上下文动态适配 |

| 扩展成本 | 新增维度需改代码 | 仅需调整Prompt |

| 维护难度 | 规则膨胀,难以管理 | 模型统一更新即可 |

七、底层原理与技术支撑

LLM在睡眠健康场景中的落地,离不开以下底层技术的支撑:

MoE(混合专家,Mixture of Experts)架构:如DeepSeek采用Hybrid MoE 3.0,在1.2万亿总参数下仅激活780亿,实现算力效率革命-31

MLA(多头潜在注意力,Multi-head Latent Attention) :将KV缓存压缩率提升至93.3%,大幅降低推理时的显存占用-31

FP8混合精度训练:在保持模型精度的同时降低计算资源消耗-

RAG(检索增强生成,Retrieval-Augmented Generation) :让模型能访问私有数据,解决幻觉问题-49

正是这些底层技术的协同,让大模型能够以可接受的成本,支撑起睡眠健康分析这类垂直场景的应用。

八、高频面试题与参考答案

Q1:请简述Transformer中的自注意力机制及其作用。

参考答案:自注意力机制通过Q、K、V三个矩阵的计算,让模型在处理序列时能动态关注不同位置的相关性,捕捉长距离依赖关系。其优势在于并行计算——相比RNN的顺序处理,训练速度大幅提升-59。多头注意力进一步将计算拆分为多个子空间,增强模型表达能力。

Q2:MoE架构如何实现“大容量、低计算”?

参考答案:MoE将模型拆分为多个“专家”子网络,通过门控网络动态选择部分专家参与推理。以DeepSeek-R2为例,总参数1.2万亿,但每次只激活约780亿参数,实际计算量仅约6.5%-。这种“稀疏激活”机制在保持模型能力的同时,大幅降低了推理成本。

Q3:为什么需要在Attention的Softmax前除以√d_k?

参考答案:随着维度d_k增大,点积结果的方差会随之增大,导致Softmax后的分布过于陡峭,大部分梯度趋近于0,造成梯度消失。除以√d_k将方差拉回1,保证梯度稳定,使模型能够有效训练-59。

Q4:RAG与微调在应用场景上有何区别?

参考答案:RAG适合知识动态更新的场景(如私有知识库问答),通过检索外部知识增强生成,成本低、可解释性强;微调适合特定任务风格或输出格式固定的场景(如客服语气),通过修改模型参数实现深度定制-49。实际开发中常采用“RAG为主、微调为辅”的混合策略。

Q5:大模型相比传统模型的主要优势有哪些?

参考答案:①任务泛化能力:无需针对每个任务单独训练;②少样本学习:通过Few-shot Prompt即可适应新任务;③长距离依赖建模:自注意力机制优于RNN;④并行计算:训练效率远高于传统序列模型-59。

九、结尾总结

核心知识点回顾

Transformer是LLM的技术基石,自注意力机制是其核心创新

MoE架构实现了“大容量、低计算” ,以1.2万亿总参数/780亿激活参数的典型比例平衡了能力与成本

RAG是解决幻觉问题的标准方案,80%的垂直场景需求可由此覆盖

AI在睡眠健康领域的应用已从概念走向落地——斯坦福SleepFM可预测130种疾病风险,Welt的AgentZ实现个性化助眠指导,齐鲁医院发布睡眠健康管理大模型-40-7-44——大模型正在重塑健康管理行业

重点与易错点

Attention的缩放因子容易被忽略,但面试高频考查

MoE“激活参数”与“总参数” 的区别是理解其效率优势的关键

RAG与微调的适用场景需要根据业务需求精准选择

下篇预告

下一篇将深入讲解大模型的微调技术,从LoRA、QLoRA到全参数微调,结合代码实战带你掌握模型定制化的完整链路。